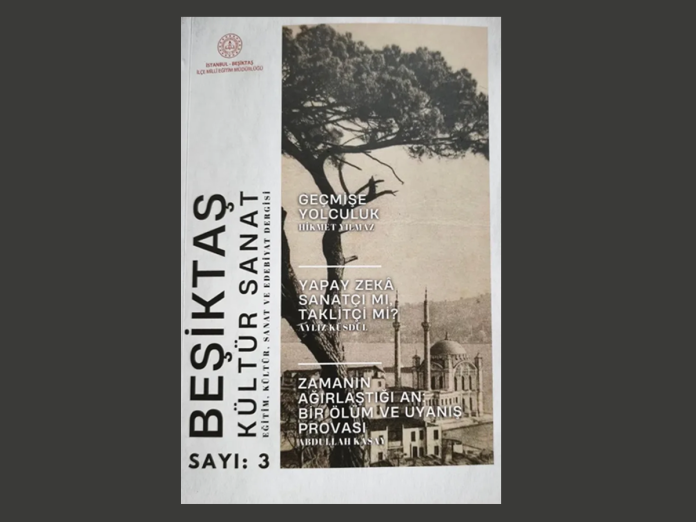

Levent Yerleşkesi ortaokul ve lise öğrencilerimizin yazıları, Beşiktaş İlçe Millî Eğitim Müdürlüğü tarafından yayımlanan Beşiktaş Kültür Sanat Dergisi’nin 3’üncü sayısında yer aldı.

Beşiktaş Kültür Sanat Dergisi’nde yazıları yayınlanan öğrencilerimiz arasında; Ali Otluoğlu (7B), Nur Günce Altınçekiç (11Fen), Lara Yavuz (10C) ve Ayliz Küsdül (11Fen) yer aldı.

Ortaokul Öğrencimizden “Arayış” Öyküsü

Ortaokul öğrencimiz Ali Otluoğlu’nun (7B) bilim kurgu türünde yazdığı “Arayış” adlı öyküsü, hayal gücünü, teknolojiyi ve geleceğe dair tasavvurları merkeze alan kurgusuyla dikkat çekti. Ali Otluoğlu (7B), “Arayış” adlı öyküsünde yaşanabilir bir gezegen arayışındaki iki farklı medeniyetin karşılaşmasını ele aldı.

Ortaokul öğrencimiz Ali Otluoğlu’nun (7B) bilim kurgu türünde yazdığı “Arayış” adlı öyküsü, hayal gücünü, teknolojiyi ve geleceğe dair tasavvurları merkeze alan kurgusuyla dikkat çekti. Ali Otluoğlu (7B), “Arayış” adlı öyküsünde yaşanabilir bir gezegen arayışındaki iki farklı medeniyetin karşılaşmasını ele aldı.

Lise Öğrencilerimizden Yapay Zeka Konulu Yazılar

Dünya Felsefe Günü kapsamında gerçekleştirilen “Yapay Zekâ Etiği: Fırsatlar, Riskler ve Sorumluluklarımız” başlıklı bir öğrenci panelinin ardından lise öğrencilerimiz, yaptıkları nitelikli akademik hazırlığı panel konuşmalarında sundu ve yazıya dönüştürdü. Beşiktaş Kültür Sanat Dergisi’ne gönderilen yazılar, yapay zekâ meselesini farklı yaklaşımlar ile ortaya koydu.

Nur Günce Altınçekiç (11Fen), “Algı, Dezenformasyon ve Yapay Zeka: Gerçeğin Yeniden Kurgulanması” başlıklı yazısında yapay zekanın, yanlış bilginin üretilmesi, yayılması ve gerçekliğin manipüle edilmesi süreçlerinde oynadığı rol üzerinden; dijital çağda algının nasıl dönüştüğünü ve dezenformasyonun felsefi, toplumsal ve etik boyutlarını tartışmaya açtı.

Nur Günce Altınçekiç (11Fen), “Algı, Dezenformasyon ve Yapay Zeka: Gerçeğin Yeniden Kurgulanması” başlıklı yazısında yapay zekanın, yanlış bilginin üretilmesi, yayılması ve gerçekliğin manipüle edilmesi süreçlerinde oynadığı rol üzerinden; dijital çağda algının nasıl dönüştüğünü ve dezenformasyonun felsefi, toplumsal ve etik boyutlarını tartışmaya açtı.

Lara Yavuz (10C), “Yapay Zeka ve Hukuk İkilemi” adlı yazısında, yapay zekanın, hukuki sorumluluk, adalet, tarafsızlık ve karar verme süreçleri üzerindeki etkileri üzerinden; yapay zekanın bir “hukuki özne” olup olamayacağı ve insanın adalet anlayışının teknoloji karşısında nasıl dönüşeceği üzerine bir tartışma yürüttü.

Ayliz Küsdül (11Fen), “Yapay Zeka- Sanatçı mı, Taklitçi mi? Bir Yapay Zeka Sanat Yapabilir mi, Sanatçının Emeğini İhlal Eder mi?” başlıklı yazısında yapay zeka, sanatın doğası, yaratıcılık, taklit, estetik deneyim ve emeğin korunması gibi kavramlar üzerinden; yapay zekanın bir “sanatçı” mı yoksa yalnızca insan üretimini yeniden işleyen bir “taklitçi” mi olduğu hakkında öne sürülen argümanları değerlendirdi.

Öğrencilerimizin “Arayış”, “Algı, Dezenformasyon ve Yapay Zeka: Gerçeğin Yeniden Kurgulanması”, “Yapay Zeka ve Hukuk İkilemi” ve “Yapay Zeka- Sanatçı mı, Taklitçi mi? Bir Yapay Zeka Sanat Yapabilir mi, Sanatçının Emeğini İhlal Eder mi?” başlıklı yazılarının tam metinleri:

ARAYIŞ

Son günlerde LEMOS-9342 gezegeninin gündemine oturan büyük bir sorun vardı. Gezegenleri gittikçe soğuyordu. 2 milyar yıldır var olan gezegen artık yaşanmaz hale gelmişti. Gezegen var olduğundan bu yana hep soğuktu ancak hava her geçen gün daha da soğuyordu. Normal bir günde ortalama -21,5 dereceye kadar düşmüştü. Sular donuyor, ekinler ölüyordu. Hayvanların da nesli tükenmeye başlamıştı. Bunun gibi daha birçok sorun ortaya çıkmıştı. Bu gezegenin soğumasının nedeni LEMOS-9342 halkının kullandığı kloroflorokarbon, hidrokloroflorokarbon, halon, karbon tetraklorür ve metil klörül gibi kimyasal maddelerdi. Bu da atmosferin incelmesine ve dolayısıyla havanın soğumasına neden oluyordu. Bu zararlı maddeler, Lemosluların günlük hayatında çok önemli bir yere sahipti ve elektronik eşya, ulaşım aracı yapımında, inşaatlarda, ısınmada ve daha birçok alanda kullanılıyordu. Daha da kötüsü, bu durum geri dönülemez bir hal almıştı.

Hava her yıl 0,5 derece soğuyordu. LEMOS-9342 gezegeni yönetimi bu acımasız gerçekle yüzleştikten sonra hemen toplandı. Bir çözüm aramaya çalıştılar ancak bulabildikleri tek çözüm yeni bir gezegen aramak oldu. Bu fikir Lemos Kral’ı tarafından da onaylandı ve 13 Şubat 2072 tarihinde ekipler yeni yaşanabilir gezegenler bulmak için LEMOS-9342’den ayrıldı. Aradılar, aradılar, aradılar… Gezmedikleri galaksi, bakmadıkları gezegen kalmadı. Ancak bunlardan hiçbiri yaşanabilir gezegenler değildi. Artık sonlarının geldiğini kabul etmişlerdi, buza dönüşüp öleceklerdi.

Son bir umut Samanyolu Galaksisinin içinde gezerken mucizevi bir şey oluverdi. Daha önce varlığından habersiz oldukları bir gezegen keşfettiler! Bu gezegen çok güzel gözüküyordu; ormanları, okyanusları, çölleri ve daha birçok şeyi vardı. Hemen bu gezegeni incelediler ve yaşanabilir olduğunu anladılar. Bu onlar için inanılmaz bir haberdi! Hemen gezegenlerine döndüler ve bu muhteşem haberi krallarına verdiler. Kral yaverleriyle bir toplantı yaptı ve bu toplantının sonunda bu yaşanabilir gezegene casuslar yollamaya karar verdi.

14 Kasım 2072 tarihinde casuslar yeni gezegene gitmek üzere LEMOS-9342’den ayrıldılar. Casuslar 1 haftalık bir yolculuğun ardından 21 Kasım 2072 tarihinde gezegene vardılar. Casuslar 1 yıldan fazla bir süre bu gezegende görev yaptı ve 22 Şubat 2074’te LEMOS-9342’ye geri döndü. Casusların raporuna göre-gezegenin yerli halkı buraya Dünya adını vermiş-çok güzel bir gezegendi ancak bazı sorunları vardı. Öncelikle Dünya, LEMOS-9342’nin aksine sıcaklığı her yıl 0,4 derece artıyordu ve bu sıcaklık Lemoslular için oldukça fazlaydı. Ancak bunu önlemek için önlemler alınırsa bu sorun engellenebilirdi. Bir diğer sorun ise popülasyondu. Dünya’nın nüfusu 13,5 milyardı ve her yıl artmaya devam ediyordu. Sonuncu sorun ise doğal kaynaklardı. Dünya’da yaşayan insanlar doğal kaynakları bilinçsizce tüketmişti ve doğal kaynaklar azalmıştı. Bu büyük sorular çözülmek zorundaydı çünkü başka çareleri yoktu. Hayatlarını kurtarmak istiyorlarsa Dünya’da yaşamaya başlamalıydılar.

Dünya’nın sorunlarını çözebilmek için LEMOS-9342 gezegeninde yaşayan bütün bilim insanları çalışmaya başladı ve sonunda bu sorunlara nispeten çözüm buldular. Küresel ısınmayı yok etmek ve soğumayı sağlamak için Dünya’nın atmosferine müdahale edip kalınlaştıracaklardı. Böylece Dünya daha da soğuyacaktı.

Popülasyon sorununu çözmek içinse insanların çocuk yapmasına izin verilmeyecekti. Nüfus 2 milyarın altına indiğinde ise LEMOS-9342 halkı Dünya’ya yerleştirilecekti. Son olarak doğal kaynakları arttırmak için kaynaklar çok ölçülü kullanılacaktı. Denizlerden su elde edilecek, yenilenebilir enerji kullanılacak ve doğaya hiç zarar verilmeyecekti. İlk 20 sene düzenli olarak su kesintileri yaşanacaktı.

Bu gezegeni ele geçirebilmek için oradaki halka hükmetmek gerekiyordu. Casuslardan elde edilen bilgilere göre Dünya’nın yaklaşık 1 milyar askeri vardı, LEMOS-9342 gezegeninin ise sadece 180 milyon askeri vardı. Ancak LEMOS’un teknolojisi Dünya’nın epey ilerisindeydi. Yapılan son toplantıda LEMOS-9342 Başkomutanlığı Dünya’ya saldırmaya karar verdi. Büyük gün geldi. 22 Ağustos 2074’de LEMOS 9342 Silahlı Kuvvetleri harekete geçti. 1 haftalık bir yolculuğun ardından birlikler Dünya’ya vardı. 4 Eylül 2074 saldırı başladı.

Savaş 8 yıl sürdü. Bu savaş insanlık tarihinin en ölümcül savaşıydı. Tam olarak 3 milyar kişi hayatını kaybetti. Şehirler haritadan silindi. Savaş sonrasında da 720 milyon kişi zehirli maddelerden dolayı hayatını kaybetti. Dünya hiç yaşanmaz bir hale geldi. Peki, bunca yıl süren korkunç savaşın sonunda ne oldu? Ateşkes.

LEMOS-9342 hiçbir şey uğruna yaklaşık 4 milyar kişinin ölümüne sebep oldu. LEMOS birlikleri 8 Ekim 2082 tarihinde Dünya’yı terk etti. Arkalarında ise ölü bir gezegenden başka bir şey bırakmadılar. LEMOS-9342 gezegenindeki yaşam 32 yıl sonra, Dünya’daki yaşam ise 51 yıl sonra tamamen yok oldu.

Ali Otluoğlu (7B)

ALGI, DEZENFORMASYON VE YAPAY ZEKA: GERÇEĞİN YENİDEN KURGULANMASI

Dezenformasyon kelimesi İngilizce “disinformation”dan gelir ve özellikle yanlış bilginin kasten yayılması anlamına gelir. Sosyal medyanın yaygınlaşmasıyla birlikte doğruluğu olmayan düşüncelerin dolaşıma girmesi çok daha kolaylaştı. Instagram’da birkaç beğeni için yalan haber yayan hesaplardan, YouTube’da izlenme almak için videoları manipüle eden içerik üreticilerine kadar pek çok örnek görüyoruz.

Ancak yapay zekânın hayatımıza girmesiyle bu süreç bambaşka bir hız kazandı. Google’da yüzlerce siteyi karşılaştırmak yerine ChatGPT’ye “En iyi brownie tarifini ver” yazıp hemen uygulamaya geçiyoruz. Peki, ChatGPT’nin verdiği tarifin gerçekten “en iyi” tarif olduğunu nereden bileceğiz? Diğer tarifleri bilmiyoruz ki. Üstelik “en iyi” kime göre, hangi damak tadına göre?

Bu yıl yapılan bir araştırmaya göre ChatGPT’ye günde yaklaşık 2,5 milyar mesaj gönderiliyor. Bu mesajların %29’u “pratik rehberlik” soruları: “Geçen yıl enflasyon neydi?”, “Kırık kol ne kadar sürede iyileşir?” gibi. Peki, yapay zekâ bu bilgileri nereden alıyor? Hepimizin erişebildiği internetten. Ama önemli bir fark var: Yapay zekâ, kaynağın doğruluğunu, taraflı olup olmadığını, bilginin niyetini veya güncelliğini sorgulamıyor.

Üstelik yapay zekâ sektörü adeta bir yarış alanına dönüşmüş durumda. Meta, Google, Yandex, Microsoft ve daha niceleri kendi sistemlerini hızla piyasaya sürüyor. Hatta bazı şirketler, kullanıcıları ücretli sürümlere yönlendirmek için ücretsiz modellerini bilinçli şekilde kısıtlıyor. Google, yıllardır bir arama motoruyken, yapay zekâ yarışında geri kalmamak için Gemini’yi geliştirdi. Bunun sonucunda Google aramalarının sayfa sayısı azalırken internetteki bilgiye erişim biçimimiz de değişti. İnternetten içerik kaldırılmış olabilir, ama bir kez dijitale düşen şeyin tamamen yok olması mümkün değildir.

Dezenformasyonun en çarpıcı örneklerinden biri ise hepimizin duyduğu “deepfake” teknolojisi… Kişisel Verileri Koruma Kurumu, deepfake’i “yüz, ses ve hareketlerin gerçeğe uygun şekilde taklit edilmesi” olarak tanımlıyor. Bu teknolojiyle oluşturulan görüntüler yalnızca komik videolarda değil; siyasi propaganda, şantaj, tehdit, manipülasyon ve dolandırıcılık gibi ciddi alanlarda da kullanılıyor. Bugün internette gördüğünüz bir videonun gerçek olup olmadığını anlamak eskisi kadar kolay değil.

2019’da Tonight Show sunucusu Jimmy Fallon’ın Trump gibi konuşturulduğu deepfake video bunun erken örneklerindendi. Bugün dünyanın birçok siyasetçisinin sesi ve görüntüsü taklit edilerek dolaşıma sokuluyor. Farklı ideolojilerden gruplar sosyal medyada yapay zekâ üretimi videoları propaganda amacıyla paylaşıyorlar. Deepfake, sadece siyaseti değil, sıradan insanların hayatını da altüst edebilecek bir güce ulaşmış durumda. Bir kişinin itibarını saniyeler içinde yok etmek artık teknik olarak mümkün.

Platon’un Mağara Alegorisi: Dijital Çağın Yeni Mağarası

Tam da bu noktada, yapay zekâ ve dezenformasyon tartışmasını düşünürken Platon’un Mağara Alegorisini hatırlamak gerekiyor. Platon, mağaranın duvarına yansıyan gölgeleri “gerçek” sanan insanlardan söz eder. Bu insanlar, arkasındaki ateşi, gölgeleri oluşturan nesneleri ve dışarıdaki gerçek dünyayı bilmezler; yalnızca kendilerine gösterileni görürler. Gölgeleri hakikat zannederler.

Bugün sosyal medya ve yapay zekâ, modern dünyanın mağarasını oluşturuyor. Algoritmalar neyi göreceğimizi, hangi bilginin önümüze düşeceğini ve hangi “gölgeleri” gerçek sanacağımızı belirliyor. Deepfake videolar, manipüle edilmiş fotoğraflar, algoritmaların süzdüğü içerikler… Tıpkı mağara duvarına düşen gölgeler gibi, bunlar da bize gerçeğin sadece bir yansımasını veriyor.

Eğer sorgulamazsak, doğru kaynaklarla karşılaştırmazsak veya düşünmeyi tamamen yapay zekâya bırakırsak, gölgeleri gerçek sanan mağara insanlarına dönüşme riskimiz var. Platon’un eleştirisi bugün belki hiç olmadığı kadar güncel:

“Sorgulamayan, düşünmeyen kişi hakikati değil, yalnızca gösterileni görür.”

Yapay zekâ çağında en büyük tehlike, sadece yanlış bilgiye maruz kalmak değil; yanlış olanı gerçek sanmaya alışmak. Mağaradan çıkmak ise hâlâ mümkün — ama bunun yolu dikkatli olmak, sorgulamak ve bilgiyi doğrulama sorumluluğunu başkasına bırakmamak.

Ama sorun sadece deepfake de değil. Yapay zekâ “bilmiyorum” demeyi bilmiyor. Bu nedenle yanlış cevap üretse bile bunu büyük bir özgüvenle söylüyor. Eğer kullanıcı da bunu sorgulamazsa, dezenformasyon zincirinin bir parçasına dönüşüyor. Bilmediğini bilmeyen bir teknoloji ile sorgulamayan bir kullanıcı birleştiğinde ortaya tehlikeli bir karışım çıkıyor.

Burada sormamız gereken temel felsefi sorular var: Yanlışı ve doğruyu ayırt edemeyen bir mekanizma gerçekten “bilir” mi? Sadece veri işleyen bir sisteme zekâ demek ne kadar doğru? İnsanlar bir metni bile okumak yerine yapay zekâdan özet istiyorsa, dezenformasyonla nasıl mücadele edeceğiz? Firmalar ve devletler yapay zekâyı gerçekten toplumun iyiliği için mi halka açıyorlar, yoksa çıkarları için mi?

Tabii yapay zekânın sadece olumsuz yönlerinden bahsetmek haksızlık olur. Doğru kullanıldığında eğitim ve araştırma için önemli bir araç olabilir. Örneğin “Bu metne hangi açıdan bakmalıyım?” gibi yönlendirici bir soru sorulduğunda yapay zekâ insanı geliştiren bir çerçeve sunabilir. Önemli olan, düşünme görevini tamamen ona devretmemek.

Son günlerde Google, Gemini’nin “Nano Banana” modelini tanıttı. Bu model çok daha gerçekçi görüntüler üretiyor. Bu bir teknoloji başarısı mı yoksa insanlık üzerinde etik bir deney mi, bunu zaman gösterecek. Ama şu kesin: İnsanlık bu gücü nasıl kullanacağını belirlemek zorunda. Yapay zekâ bizi düşünmekten uzaklaştıran bir araç mı olacak, yoksa düşünmeyi daha derin hale getiren bir yardımcı mı?

Bugün geldiğimiz noktada en kritik soru şu: Doğru bilginin gerçekten değeri kaldı mı? Yoksa tek önemli olan bilgiye hızlı ulaşmak mı?

Ve son olarak: Yapay zekâ tarafından üretilen yanlış bir içerik bir gün bize zarar verdiğinde, sorumluluğu kime yükleyeceğiz?

Uzun uzun değinemeyeceğim ancak şu bağlamı da hep birlikte düşünmeye davet ediyorum: Yapay zekâ, bilgiye hızlı erişim imkânı sunduğu iddia edilse de —ki bu sistemlerin ürettiği çıktıların doğruluğu başlı başına tartışmalıdır— her bir yapay zekâ komutunun yaklaşık 2 ila 5 litre arasında su tükettiği dikkate alındığında, gezegenimizin ciddi ekolojik krizlerle karşı karşıya olduğu günümüzde, bu teknolojilere başvurmanın etik meşruiyeti sorgulanmalıdır.

Nur Günce Altınçekiç (11Fen)

YAPAY ZEKA VE HUKUK İKİLEMİ

Sizlere yapay zekânın insanla kurduğu yeni ilişkinin sadece teknolojik bir ilerleme olmadığını; karar verme, sorumluluk alma ve güven anlayışımızı doğrudan etkileyen bir değişim olduğunu anlatmayı amaçlıyorum.

Yazım üç ana başlık altında ilerleyecek: İlk olarak yapay zekânın “karar verebilme” iddiasının felsefi yönüne bakacağım; ardından yapay zekânın adalet ve tarafsızlıkla kurduğu ilişkiyi; son olarak da bu sistemlerin hukuken bir “özne” olarak kabul edilip edilemeyeceğinden söz edip yazımı geleceğe dair bir soru ile bitireceğim.

Konuyu biraz daha somutlaştırmak için hepimizin aklından zaman zaman geçen birkaç durumu düşünelim. Örneğin; bir ameliyata girdiğinizi ve operasyonu ağırlıklı olarak yapay zekâ destekli bir cerrahi robotun yönettiğini hayal edin. Kendinizi bir robota teslim eder miydiniz? Aynı şekilde, kokpitinde insan bulunmayan bir uçağa binme fikri sizi ürkütür müydü? Peki yapay zekânın tasarladığı bir köprüden geçerken o yapının sağlamlığına güvenir miydiniz? Ve belki de en gündemde olanı: Tam otonom bir araca binmekte tereddüt eder miydiniz?

Yapay zekâ sistemlerinin artık karar niteliğinde sonuçlar üretmesi, insanın kendi karar verme anlayışını yeniden düşünmesine yol açıyor. Çünkü karar vermek yalnızca bir seçenek belirlemek değil; değerleri tartmak, anlamlandırmak ve sonuçlarını üstlenmektir. İnsan kararlarını diğer canlılarınkinden ayıran şey tam olarak bu sorumluluk bilincidir. Yapay zekâ ise aynı sonuca çok hızlı ulaşabilir, ancak kararının anlamını kavrayamaz; çünkü ürettiği her sonuç, eğitildiği verilerin sınırları ve algoritmanın tercihleriyle şekillenir. Burada önemli bir fark oluşuyor: İnsan karar verirken niyet taşır, bilinç taşır ve sonuçla ilişki kurar; yapay zekâda ise niyet ve öznel değerlendirme yoktur. Bu fark özellikle etik ikilemlerde belirginleşir.

MIT’nin geliştirdiği Moral Machine çalışması bu bağlama dair çarpıcı bir örnek sunar. Milyonlarca kişi, tam otonom bir aracın kazasında kimin can güvenliğinin korunması gerektiği sorusuna farklı cevaplar vermiştir; yaşa, statüye, davranışlara ve kültürel değerlere göre tamamen değişen tercihler ortaya çıkmıştır. Bu sonuç, etik kararların evrensel bir formülü olmadığını; toplumların değerleriyle, deneyimleriyle ve adalet anlayışlarıyla şekillendiğini gösterir. Yapay zekâ ise bu tür değerlendirmelere erişemez; yaptığı şey etik bir tartım değil, veri istatistiklerinin sonucudur. Bu noktada hukuk ve ahlak arasındaki yakın ilişki de belirginleşir: Bir kararın hukuken nasıl değerlendirileceği, çoğu zaman o toplumun adalet anlayışına dayanır.

Yapay zekânın etik bir değerlendirme yapamamasının sonuçlarını sadece deneysel senaryolarda değil, gerçek adli uygulamalarda da görüyoruz. Ona etik kurallar tanımlanabilir, fakat bu kuralları insan gibi anlamlandırması mümkün değildir; çünkü bir kuralı uygulamakla o kuralın neden ve hangi bağlamda geçerli olduğunu kavramak aynı şey değildir. Etik bir ilkeyi uygulamak bağlam, niyet ve sorumluluk ilişkisini anlamayı gerektirir. Yapay zekâya bu değerler tanımlanabilir ama tanımlanmış bir değer, içselleştirilmiş bir değer değildir.

Bu durumun en belirgin örneklerinden biri ABD’de mahkemelerde kullanılan COMPAS karar destek sisteminde görüldü. Sistem, sanıkların gelecekte suç işleme riskini tahmin etmeyi amaçlıyordu; ancak yıllar içinde açıkça ortaya çıktı ki model, ten rengi üzerinden oluşmuş tarihsel önyargıları aynen yeniden üretiyor ve özellikle bazı etnik grupları sistematik olarak “daha yüksek riskli” gösteriyordu. Buradaki sorun algoritmanın matematiksel bir hata yapması değildi; verilerde gömülü duran adaletsizliği etik bir süzgeçten geçirecek bir bilinçten yoksun olmasıydı.

Benzer bir örneği işe alım algoritmalarında görüyoruz. Örneğin; Amazon’un uzun süre kullandığı işe alım sistemi, kadın adayları sistematik olarak düşük puanlamaya başladı. Bunun nedeni yazılımın “kadınlara karşı olması” değildi; modele öğretilen verilerin büyük kısmı geçmişte erkeklerin daha fazla işe alındığı başvurulardan oluşuyordu. Sistem, tarihsel hatayı bir norm olarak algılayıp yeniden üretmişti. Bu durum hukuk açısından kritik bir soru doğuruyor: Bir sistem niyet taşımadığı hâlde ayrımcılık üretebilir mi? Evet, üretebilir. Çünkü adaletsizliğin kaynağı niyet değil, verinin yapısı olabilir.

Yapay zekânın karar verdiği durumlarda bir diğer sorun da sorumluluk meselesidir.

Yapay Zekâ Hata Yaptığında Sorumluluk Kime Aittir?

Yapay zekânın karar süreçlerine dâhil olması, sorumluluğun kimde olduğu konusunda büyük bir kafa karışıklığına yol açmaktadır. Çünkü hukuki bir olayda ilk sorulan soru şudur: “Bu fiilin faili kimdir?” Fail, eylemin sonuçlarını üstlenebilen kişidir. Hukukta kusur, ancak irade ve niyet ile mümkündür. Yapay zekâda bu unsurlar bulunmadığından, onu hukuken “fiilin sahibi” olarak görmek mümkün değildir.

Bu nedenle yapay zekânın ürettiği bir sonucun sorumluluğu kaçınılmaz olarak arka plandaki insanlara yönelir: sistemi tasarlayan mühendislere, modeli geliştiren şirkete ya da sistemi kullanan kişiye. Fakat olay gerçek bir örneğe dönüştüğünde sorumluluğu nereye yerleştireceğimiz bir anda bulanıklaşır.

Tesla’nın Autopilot sistemiyle gerçekleşen kazalar buna önemli bir örnektir. Mahkemeler yazılımın kendi başına “suçlu” olamayacağını açıkça belirtti. 2019’da Florida’da yaşanan bir kazada jüri, kavşağa hız kesmeden giren tam otonom aracın tasarımındaki eksiklik nedeniyle Tesla’yı kusurlu bularak 243 milyon dolar tazminata hükmetti. Burada cezalandırılan sistem değil, sistemin arkasındaki insan örgütlenmesiydi.

Benzer bir durum tıbbi tanı yazılımlarında da ortaya çıkıyor. Bir yapay zekâ yanlış teşhis koyduğunda hukuk, sorumluluğun yazılımcıya mı, sistemi kullanan doktora mı, yoksa hastaneye mi ait olduğunu belirlemek zorunda kalıyor.

Tüm bu örnekler şunu gösteriyor: Yapay zekâ ne kadar gelişmiş olursa olsun hukuki sorumluluk hâlâ insana dönüyor. Ancak “hangi” insan olduğu sorusu giderek karmaşıklaşıyor.

Adalet, Tarafsızlık ve Ayrımcılık: Yapay Zekâ Gerçekten “Nesnel” midir?

Yapay zekâ çoğu zaman tarafsız, duygusuz ve dolayısıyla “en adil” karar verici gibi sunulur. Çünkü insanlar önyargılı olabilir; ama makine sadece verilere bakar. Bu yaklaşım gerçek uygulamalara bakıldığında sarsılıyor. Bir sistemin tarafsızlığı, ancak beslendiği verilerin tarafsızlığı kadar mümkündür.

Son yıllarda yüz tanıma teknolojilerinde bazı etnik gruplara yönelik hata oranlarının çok daha yüksek olduğu ortaya kondu. Bir güvenlik sisteminin yalnızca veri dengesizliği yüzünden belirli bir grubu daha yüksek “risk” kategorisine yerleştirmesi, hukukun en temel ilkesi olan eşitlik ile açık bir çatışma yaratıyor.

Bu vakalar yapay zekânın tarafsız olduğuna dair varsayımın ne kadar kırılgan olduğunu gösteriyor. Yapay zekâ tarafsız görünür ama tarafsızlık üretemez. Çünkü adalet sadece doğru istatistikler değil; bağlamı görmek, hakkaniyeti gözetmek ve güç dengesizliklerini fark edebilmektir. Bunlar ise etik sezgi gerektirir.

Bütün bu tartışmalar hukukun geleceğini de ilgilendiriyor. Yapay zekâ artık yalnızca veri analiz eden bir araç değil; sözleşme taslakları hazırlayan, mahkeme kararlarını öngören, hatta hâkimlere davalarda nasıl karar vereceklerini söyleyen sistemler olarak karşımıza çıkıyor. Bu durum şu soruyu gündeme getiriyor: Eğer karar süreçlerinin önemli bir kısmı yapay zekâya devredilirse hukuk insanın mesleği olmaya devam edecek mi?

Bugün bazı ülkelerde dava dosyalarını özetleyen ve hâkime “olası sonuç” öneren sistemler deneniyor. İlk bakışta masum bir destek gibi görünen bu uygulama iki risk doğuruyor: İlki hâkimin zamanla yapay zekânın çıktısını “doğru karar” gibi görmeye başlaması; ikincisi ise kararın gerekçesinin şeffaf olmayan bir algoritma tarafından oluşturulmasıdır. Bu durumda karar kâğıt üzerinde hâlâ hâkime ait görünse de arka planda takdiri yapanın kim olduğu bulanıklaşıyor.

Benzer bir durum avukatlık mesleğinde de yaşanıyor. Bugün yapay zekâ sistemleri binlerce sayfalık içtihadı dakikalar içinde tarayıp ilgili kararları listeleyebiliyor. Bu avukatın işini kolaylaştırır gibi görünse de uzun vadede “hukuki muhakemenin” ne kadarının insanda kalacağı sorusunu gündeme getiriyor.

Bu koşullar altında “yapay zekâ hâkim olsun mu?” sorusu sadece teknik bir verimlilik problemi değil; hukukun özünün ne olduğu ile ilgili bir sorudur. Hukuk sadece kuralların uygulanması değil, aynı zamanda toplumun adalet duygusunun temsilidir. Bir kararın adil sayılabilmesi çoğu zaman o kararı veren kişinin gerekçesini açıklayabilmesine ve eleştiriye açık olmasına bağlıdır. Yapay zekâ ise bugün için ne hesap verebilir ne de eleştiriden ders çıkarabilir.

Bu nedenle geleceğe dair asıl sorumuz, yapay zekâyı hukukun dışına itmek ya da onu tek başına hâkim yapmak değildir; hangi noktaya kadar yardımcı, hangi noktadan sonra belirleyici olmasına izin vereceğimizdir. Hukuk, insanın adalet arayışının kurumsallaşmış hâliyse soruyu şöyle sormak gerekiyor:

Yapay zekâ hukuka ne kadar dâhil olursa olsun, son sözü kimin söylemesini istiyoruz — sistemin mi, yoksa hâlâ insanın mı?

Lara Yavuz (10C)

YAPAY ZEKA- SANATÇI MI, TAKLİTÇİ Mİ? BİR YAPAY ZEKA SANAT YAPABİLİR Mİ, SANATÇININ EMEĞİNİ İHLAL EDER Mİ?

Şarkıya buradan ulaşabilirsiniz.

Yukarıdaki bağlantılardan ulaşabileceğiniz şarkı bir yapay zekâ tarafından bestelenmiştir. Peki bu durum dinlediğiniz şeyi “sanat” olarak nitelendirmemizi engeller mi?

Bu sorunun tek bir cevabı yok; çünkü sanatın ne olduğuna dair farklı görüşler ve tanımlar mevcut. Sanat üzerine yüzlerce yaklaşım varken ben bugün yalnızca tartışmayı aydınlatmaya yardımcı olacak üç temel estetik bakış açısından ilerleyeceğim. Farklı görüşlere girmememin nedeni, konuyu sade tutmak ve yapay zekâyı değerlendirmek için kullanışlı bir çerçeve oluşturmak.

Ama önce şunu bilmeliyiz: Yapay zekâ eserlerini nasıl üretiyor?

Kısaca söylemek gerekirse, yapay zekâ büyük veri setlerinden öğreniyor. Bu veri setleri daha önce insanlar tarafından üretilmiş resimler, müzikler ve metinler gibi içeriklerden yani daha önce insan tarafından üretilmiş içeriklerden oluşuyor. Yapay zekâ bu verilerdeki örüntüleri, teknikleri ve temaları analiz ederek bunları yeniden birleştirip “yeni” bir şey oluşturuyor. Ancak burada önemli olan, yapay zekânın bunu bilinç, duygu ya da deneyimle değil; tamamen istatistiksel örüntülerle yapmasıdır.

Yapay zekânın az çok nasıl eserlerini oluşturduğunu öğrendiğimize göre, sanata ilişkin tanımlar ile kıyaslamaya geçebiliriz:

Leo Tolstoy, ünlü Rus yazar ve sanat kuramcısıdır; eserleri ve sanata dair düşünceleri toplum tarafından uzun yıllar saygıyla değerlendirilmiş ve tartışılmıştır. Tolstoy, sanatın amacını izleyicide duygu uyandırmak ve insanlar arasında duygusal bağ kurmak olarak tanımlar. Ona göre, sanatçının amacı, izleyiciyle iletişim kurmaktır. Yapay zekânın oluşturduğu eserler bu perspektifte değerlendirildiğinde, yapay zekânın eserlerini bilinçli bir duygu ile üretmediğini lakin izleyicide duygusal bir tepki uyandırabileceğinden ötürü Tolstoy’un kriterlerinin bir kısmını karşılar. Peki bir kısmını karşılaması yine de bu eserleri bir sanat yapar mı?

Benedetto Croce, İtalyan filozof ve estetik kuramcıdır; sanata dair fikirleri modern estetik felsefesine öncülük etmiştir. Ona göre sanat, sanatçının içsel dünyasının ve duygularının estetik biçimde dışavurumudur; teknikten çok, ruhun yansıması önemlidir. Croce perspektifinden bakıldığında, yapay zekâ bilinçli bir içsel dünya veya duygusal ifade üretmediği için bir “sanatçı” olarak kabul edilemez ve ürettiği eserlere de sanat diyemeyiz.

Şimdi de spesifik bir kişiden ziyade, modern estetik kuramının tanımı üzerinden değerlendirelim. Modern estetik kuramı, sanatı izleyicide estetik bir deneyim uyandıran üretim olarak tanımlar; üreticinin kim olduğu veya niyeti ikincil önemdedir. Buradan bakıldığında, yapay zekâ tarafından üretilmiş müzik, izleyicide estetik bir deneyim uyandırıyorsa sanat olarak değerlendirilmesinde sakınca yoktur.

Son olarak Platon’un sanat anlayışı üzerinden gidecek olursak, kendisi sanat üzerine sistematik düşünen ilk büyük filozoflardan biridir ve sonrasında gerçekleşen batı sanat felsefesinin çoğu tartışmasına da zemin oluşturmuştur. Platon’a göre sanat doğanın veya gerçekliğin taklididir. Sanatçı, gerçekliği yansıtarak ideâl formları izleyiciye sunar. Lakin Platon’un sanat anlayışı üzerinden gittiğimizde insan da önceden var olan doğa ve görünür gerçeklikten öğrenip birleştirerek sanat eseri üretmiş oluyor.

Peki, insan doğayı taklit ediyorsa ve yapay zekâ da insanı taklit ediyorsa o zaman yapay zekâ dolaylı olarak insanların yaptığı gibi sadece doğayı mı taklit ediyor?

İlk bakışta durum bu gibi görünse de arada çok önemli bir fark var. İnsan taklit ederken yalnızca gördüğünü yeniden üretmez; deneyimlerini, duygularını, kültürel birikimini ve bilinçli seçimlerini sürece katar. Yani insanın taklidi bir yorumdur. Yapay zekâ ise doğayı değil, insanın doğayı yorumlama biçimini taklit eder. Bu nedenle yapay zekânın ürettiği şey ‘taklidin taklidi’dir. İnsan; bilinç, duygu ve deneyim üzerinden yaratıcı bir dönüşüm yaparken yapay zekâ yalnızca veriyi işler, örüntüleri tekrarlar. Kendi deneyimlerini, duygularını kültürel birikimini veya kendi aldığı kararları bu sürece katmaz.

İşte tam bu noktada yapay zekânın sanatçının emeğini ihlal edip etmediği tartışması başlar; çünkü insanın yaratıcı yorumundan doğan eserler, yapay zekâ tarafından yeniden işlenmekte ve çoğaltılmaktadır.

Geçtiğimiz aylarda OpenAI’ın görsel üretim modelleri, insanların kendi fotoğraflarını “Ghibli tarzı” çizimlere dönüştürmesine olanak tanıdı ve bu trend sosyal medyada büyük bir hızla yayıldı. Ancak bu popülerlik, Studio Ghibli başta olmak üzere Japon yaratıcı topluluklarını rahatsız etti; çünkü yıllar boyunca özenle oluşturulan çizim tarzı ve estetik dil, yapay zekâ tarafından izinsiz bir şekilde taklit ediliyordu. 2025 sonunda CODA aracılığıyla OpenAI’a gönderilen resmi uyarı, telifli içeriklerin AI modellerinin eğitimi için kullanılmasına son verilmesini talep etti. Sora 2 gibi video ve animasyon üretebilen modellerin devreye girmesiyle endişeler daha da büyüdü. Bu olay bize şunu açıkça gösteriyor: Yapay zekânın taklidi yalnızca estetik bir mesele değil; etik, hukuki ve emeğe saygı üzerine kurulu bir tartışmayı da beraberinde getiriyor.

Aynı tartışmayı 2023 yılında ABD Senaristler Birliği’nin (WGA) gerçekleştirdiği grevde de gördük. Grevin ana nedeni, yapay zekânın senaristlerin sadece işini elinden alması değil; daha önemlisi, AI ile üretilmiş içeriklerin “insan emeği” gibi sunulması ve telif hakkı talep etmesi ihtimaliydi. Aylar süren müzakereler sonucunda kabul edilen anlaşmada, yapay zekânın insan emeğinin yerine geçemeyeceği, AI tarafından yazılan içeriklerin telif hakkına sahip olamayacağı ve yaratıcı süreçte son sözün her zaman insana ait olması gerektiği vurgulandı. Bu da çağımızda yapay zekânın sanatta “yaratıcı özne” olarak değil, bir araç olarak görülmesi gerektiğini bir kez daha göstermiş oldu.

Bu iki haberden sonra aslında “Yapay zekâ emek ihlali yapıyor mu?” sorusu tartışmadan

uzaklaşıyor. Çünkü çeşitli alanlardaki sanatçıların emek ihlalinden muzdarip olduğunu ve bunun önüne geçmek için işi legal boyuta kadar taşıdıklarını görüyoruz. Yani yapay zekânın emek ihlali yapıp yapmaması bir tartışma değil, çoktan sorun haline gelmiş bir sonuçtur/durumdur.

Üzerine düşündüğümüz her şeyden sonra “Yapay zekâ sanatçı mı, taklitçi mi?” sorumuza kesin bir cevap veremediğimizi görüyoruz ama sanat kuramlarının bize sunduğu tabloda, Tolstoy’a göre: Yapay zekâ kısmen sanat üretir, ama sanatçı değildir. Croce’ye göre: Sanatçı olamaz, çünkü iç dünyadan yoksundur. Modern estetiğe göre: Estetik deneyim oluşturduğu sürece sanat sayılabilir. Platon’a göre ise: İnsan gibi taklit eder ama insanın bilinçli yorumunu üretmez.

Peki ya hakkında konuştuğumuz yapay zekâ bu konu hakkında ne “düşünüyor”? Chatgpt’ye de cevabını aradığımız “Yapay zekâ sanatçı mı, taklitçi mi?” sorusunu yönelttim ve kendisinin cevabı şu şekil oldu:

“Merhaba! Bu soru aslında hem felsefi hem de teknolojik bir tartışmayı içeriyor, o yüzden adım adım ele alalım: Yapay zekânın çalışma şekli: Yapay zekâ, özellikle görsel sanat ve müzik üreten modeller, büyük miktarda insan üretimi veriyi analiz ederek çalışır. Bu veri üzerinden örüntüleri öğrenir ve benzer tarzda yeni içerikler üretir. Yani doğrudan “yaratıcı ilham” değil, istatistiksel modelleme ve örüntü takibi yapar. Taklit mi, sanatçı mı? Taklitçi yönü: Yapay zekâ, var olan sanat eserlerinden öğrendiklerini kullanarak yeni şeyler üretir; bu açıdan ürettiği şeyler tamamen özgün bir “insan deneyimi” veya bilinçli duygu taşımaz. Bu yönüyle taklitçi denebilir. Sanatçı yönü: Öte yandan ortaya çıkan eser bazen öngörülmeyen, estetik açıdan etkileyici ve yaratıcı görünebilir. İzleyiciye duygu aktarımı sağlayabilir. Bu durumda bazı insanlar yapay zekâyı “yaratıcı bir araç” olarak görebilir. Özetle: Yapay zekâ kendi başına sanatçı değildir; insan gibi bilinç, niyet ve estetik yargıya sahip değildir. Ancak insan yaratıcılığını destekleyen, yeni ve ilginç eserler ortaya çıkarabilen bir araç olarak kullanılabilir. Dolayısıyla, teknik olarak taklitçi ama sonuçları bazen sanat gibi algılanabilir. İstersen ben bunu tek cümlelik, net bir cevap hâline de getirebilirim, ödev veya tartışma için uygun olur. Bunu yapmamı ister misin?”

Ayliz Küsdül (11Fen)